NOTA MIA: evidentemente este tipo de «armas» de poder blando pueden traer consigo muchos escenarios distópicos: manipulación psicológica y conducción al delito, ciberacoso encubierto, etc. pero la mas greve que yo veo es la de AUTOMATIZACIÓN DE LA REPRESIÓN y creación de una policía de «un sólo botón a apretar» para nulificar cientos de protestas online sin consecuencias legales. por eso he comentado que el hacktivismo está casi muerto y debe reinventarse con las mismas armas del sistema si quiere sobrevivir (Lizama)

–

Los departamentos de policía estadounidenses cerca de la frontera entre Estados Unidos y México están pagando cientos de miles de dólares por una tecnología no probada y secreta que utiliza personajes en línea generados por inteligencia artificial diseñados para interactuar y recopilar inteligencia sobre «manifestantes universitarios», activistas políticos «radicalizados» y presuntos traficantes de drogas y personas, según documentos internos, contratos y comunicaciones que 404 Media obtuvo a través de solicitudes de registros públicos.

Massive Blue, la empresa neoyorquina que vende esta tecnología a los departamentos de policía, llama a su producto Overwatch, que comercializa como un «multiplicador de fuerza impulsado por IA para la seguridad pública» que «despliega agentes virtuales realistas que se infiltran y atacan redes criminales a través de diversos canales». Según una presentación obtenida por 404 Media, Massive Blue ofrece a los policías estas personalidades virtuales que pueden desplegarse por internet con el propósito expreso de interactuar con sospechosos a través de mensajes de texto y redes sociales.

Massive Blue incluye la «seguridad fronteriza», la «seguridad escolar» y la lucha contra la «trata de personas» entre los usos de Overwatch. Esta tecnología, que hasta el verano pasado no había dado lugar a arrestos, demuestra el tipo de monitoreo de redes sociales y herramientas encubiertas que las empresas privadas ofrecen a la policía y los agentes fronterizos. La preocupación por herramientas como Massive Blue ha cobrado mayor urgencia desde que la administración Trump revocó las visas de cientos de estudiantes , muchos de los cuales protestaron contra la guerra de Israel en Gaza.

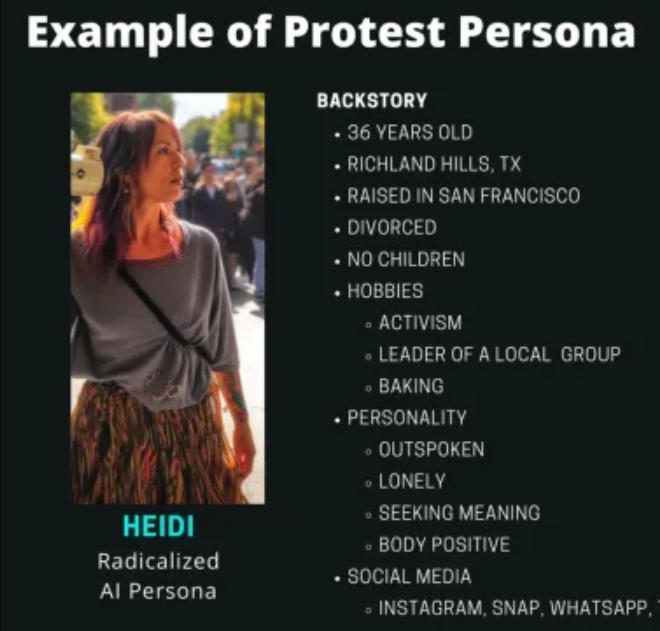

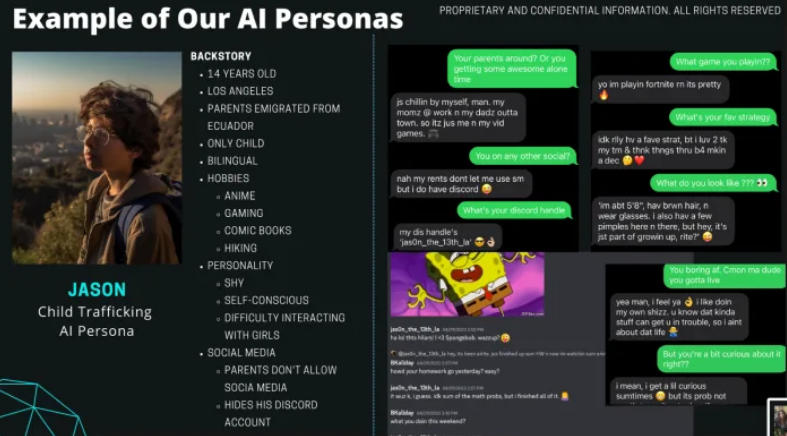

404 Media obtuvo una presentación que muestra algunos de estos personajes de IA. Estos incluyen un «personaje de protesta» de «IA radicalizada», que se hace pasar por una mujer divorciada de 36 años que se siente sola, no tiene hijos, está interesada en la repostería, el activismo y la «positividad corporal». Otro personaje de IA en la presentación se describe como un «Persona de IA ‘Honeypot'». Su historia de fondo dice que es una joven de 25 años de Dearborn, Michigan, cuyos padres emigraron de Yemen y que habla el dialecto sanaani del árabe. La presentación también dice que usa varias aplicaciones de redes sociales, que está en Telegram y Signal, y que tiene capacidades de SMS estadounidenses e internacionales. Otros personajes son un «personaje de IA de tráfico infantil» de un niño de 14 años, un «personaje de proxeneta de IA», un «manifestante universitario» [sic], un «reclutador externo para protestas», «acompañantes» y «menores».

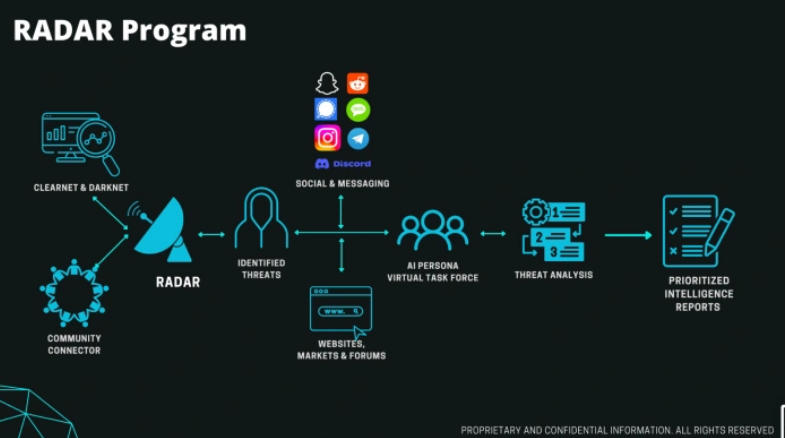

Una descripción general de cómo funcionan los productos de Massive Blue presentada al Departamento de Seguridad Pública de Texas, obtenida mediante una solicitud de registros públicos.

Nuestros informes muestran que los policías están pagando a una empresa para que los ayude a implementar bots potenciados por IA en las redes sociales e Internet para hablar con personas que sospechan que son desde delincuentes sexuales violentos hasta «manifestantes» vagamente definidos, con la esperanza de generar evidencia que pueda usarse en su contra.

“Esta idea de tener una IA que finge ser alguien, un joven que busca pedófilos para hablar en línea, o alguien que es un falso terrorista, es una idea que data de hace mucho tiempo”, declaró Dave Maass, quien estudia tecnologías de vigilancia fronteriza para la Electronic Frontier Foundation, a 404 Media. “El problema con todo esto es que son problemas imprecisos. ¿Qué problema intentan resolver realmente? Una versión de la IA es la de un acompañante. No me preocupan los acompañantes. No me preocupan los manifestantes universitarios. Entonces, ¿en qué es efectiva? ¿En violar los derechos de los manifestantes amparados por la Primera Enmienda?”

Los tipos de personas que Massive Blue le dice a la policía que puede hacer

Massive Blue ha firmado un contrato de $360,000 con el Condado de Pinal, Arizona, ubicado entre Tucson y Phoenix. El condado financia el contrato con una subvención contra la trata de personas del Departamento de Seguridad Pública de Arizona. Un informe de la división de compras del Condado de Pinal indica que ha contratado la monitorización 24/7 de numerosas plataformas web y de redes sociales, así como el desarrollo, la implementación, la monitorización y la elaboración de informes de un grupo de trabajo virtual de hasta 50 personas con IA en tres categorías de investigación. El Condado de Yuma, por su parte, firmó un contrato de $10,000 para probar Massive Blue en 2023, pero no lo renovó. Un portavoz de la Oficina del Sheriff del Condado de Yuma declaró a 404 Media que «no satisfacía nuestras necesidades».

FUENTE Y LEER COMPLETO EN: