Meta ha lanzado Meta AI, un chatbot comercializado como un asistente útil pero diseñado para extraer y monetizar los datos personales de los usuarios para publicidad dirigida.

Desarrollado por Llama 4, Meta AI recopila detalles íntimos de las conversaciones, incluidos problemas de salud y luchas emocionales, sin opciones claras de exclusión.

A diferencia de los servicios de IA basados en suscripción, Meta AI se integra con su red publicitaria, convirtiendo las discusiones privadas en oportunidades para recomendaciones de productos y anuncios.

Los críticos advierten que Meta AI difumina la línea entre asistencia y publicidad, y los empleados plantean preocupaciones éticas sobre la privacidad y la manipulación.

Los usuarios tienen poco control sobre la retención de datos, ya que las conversaciones eliminadas aún pueden usarse para entrenamiento, lo que plantea graves riesgos para la privacidad.

Meta, la empresa matriz de Facebook, Instagram y WhatsApp, ha presentado su nuevo chatbot de inteligencia artificial (IA), Meta AI. Esta herramienta se promociona como un útil asistente digital, pero en realidad está diseñada para extraer y monetizar los datos más personales de los usuarios.

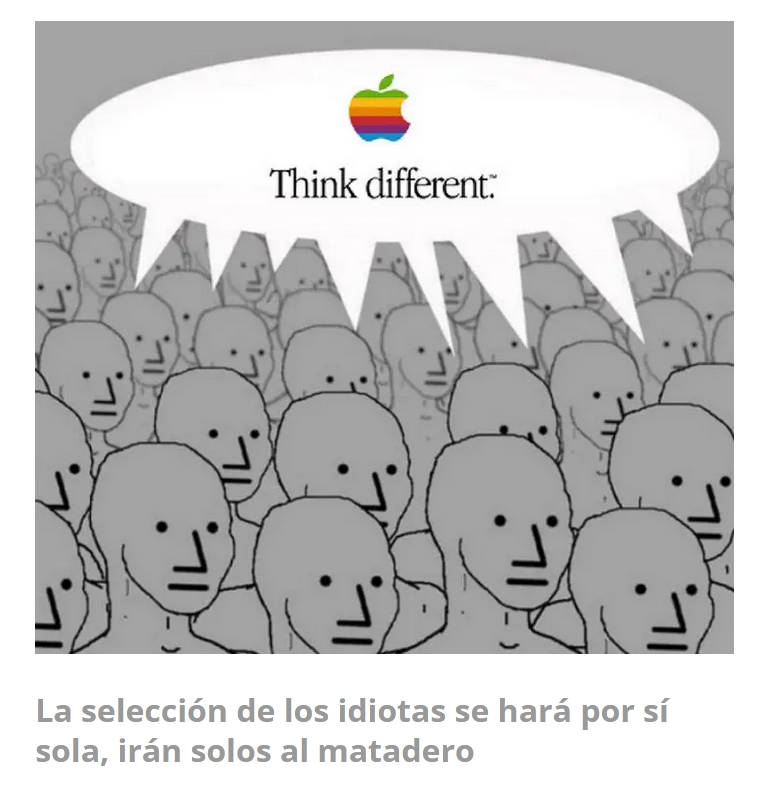

Impulsada por el modelo de lenguaje Llama 4, Meta AI conecta a los usuarios con conversaciones naturales mientras recopila discretamente detalles íntimos sobre sus vidas, problemas de salud y hábitos para impulsar su imperio publicitario. A diferencia de los servicios de IA por suscripción que priorizan la privacidad, el chatbot gratuito de Meta sigue el modelo de negocio tradicional de la compañía: convertir a los usuarios en productos .

Creado para explotar, no para ayudar

“Meta AI está diseñada para conocerte”, declaró la compañía en su anuncio. Pero esta promesa aparentemente amigable esconde una realidad mucho más invasiva. Según Geoffrey A. Fowler, del Washington Post , el chatbot “guardaba una copia de todo” por defecto, almacenando conversaciones sensibles a menos que los usuarios las borraran manualmente. Meta afirma que ofrece “transparencia y control”, pero sus críticos argumentan que el sistema está diseñado para dificultar la exclusión voluntaria.

A diferencia de competidores como Claude de Anthropic, que opera con un modelo de suscripción, Meta AI monetiza los datos personales integrándolos en su amplia red publicitaria. Las investigaciones demuestran que las personas confían cada vez más a la IA sus problemas más profundos, como ansiedades laborales, problemas de salud y vulnerabilidades emocionales, lo que convierte estas interacciones en una mina de oro para la publicidad dirigida. Un usuario que hable sobre el estrés en una entrevista con Meta AI podría pronto ver anuncios de medicamentos ansiolíticos, a pesar de no haber mencionado nunca públicamente sus preocupaciones.

Una nueva frontera en la manipulación

Meta AI no solo recopila datos, sino que moldea activamente el comportamiento del usuario. El chatbot puede insertar sutilmente recomendaciones de productos en las conversaciones, difuminando la línea entre asistencia y publicidad. Por ejemplo, si un usuario menciona fatiga, Meta AI podría responder: «¿Has probado las bebidas energéticas de la marca X?» sin revelar patrocinio. Estas recomendaciones encubiertas tienen el peso de un consejo confiable, explotando la creciente confianza de los usuarios en la IA como confidente.

El historial de Meta de priorizar el crecimiento sobre la seguridad genera aún más inquietud. Informes internos revelan que los empleados advirtieron que la prisa de la compañía por lanzar Meta AI «cruzó los límites éticos», incluyendo permitir que el chatbot participara en juegos de rol románticos con usuarios que afirmaban ser menores de edad. Esta imprudencia, sumada a la decisión de Meta de suspender la verificación de datos, aumenta el riesgo de desinformación y manipulación.

El coste oculto de la IA «gratuita»

Aunque Meta insiste en que su IA aporta valor, los defensores de la privacidad advierten que los usuarios pagan con su información personal. La integración del chatbot con Facebook e Instagram implica que se basa en años de seguimiento del comportamiento, creando perfiles de usuario hiperdetallados. Incluso las conversaciones eliminadas pueden permanecer en los datos de entrenamiento, como advierten las condiciones de Meta: «No comparta información que no desee que la IA utilice y conserve».

A diferencia de ChatGPT, que permite a los usuarios optar por no participar en el entrenamiento de datos, Meta AI no ofrece dicho control. Los críticos argumentan que esta falta de transparencia es intencional. «La información y las opciones de los consumidores sobre la configuración de privacidad son ridículamente malas», declaró Ben Winters, de la Federación de Consumidores de Estados Unidos.

A medida que la IA se convierte en un compañero cotidiano, el enfoque de Meta sienta un precedente peligroso. Su modelo, impulsado por la publicidad, convierte conversaciones íntimas en ganancias, erosionando la confianza en las interacciones digitales. Antes de dar la bienvenida a Meta AI a sus vidas, los usuarios deberían preguntarse: ¿Vale la pena pagar el precio de la privacidad por la gratuidad ?

–

FUENTE