La entrada de la teoría de la internet muerta ha sido una de las más visitadas del blog en los últimos 2 años, pues bien hoy comparto vía el substack del usuario Monsieur Grandy , una ampliación de dicha narrativa.

Nuestra historia colectiva es una narrativa mayoritariamente compartida, construida en torno a textos grabados y creados por humanos. En el lenguaje de la web, lo llamaríamos una forma de «contenido generado por el usuario». Y desde que existe Internet, la inmensa mayoría de los contenidos consumidos habían sido generados por el usuario (humano).

Cabe señalar que, a lo largo de la historia (siglo IV a.C.), el medio elegido ha sido la palabra escrita (texto). No fue hasta el daguerrotipo para las imágenes, el fonoautógrafo para el audio y el disco de Nipkow para el vídeo, que empezaron a surgir y a generalizarse formas de contenido más complejas y con más información. Y todo ello en los últimos 180 años.

Cuando se cumplen unos 30 años de historia de la red, las formas dominantes de contenido han ascendido de forma bastante monótona en la escala de carga de información e inmersión. A grandes rasgos,

texto < audio < imágenes < vídeos < 3D < RV

En los primeros días de Internet, el texto era la forma dominante de contenido compartido (piensa en los foros de la vieja escuela). Después vinieron el audio y las imágenes (MySpace, Facebook, Instagram). Y por último, el vídeo (YouTube, TikTok). Según un estudio de 2013, los vídeos generan un 1200% más de comparticiones que las imágenes y el texto juntos.

Tal vez sea que todos somos adictos a la dopamina en el fondo y ascender en la cadena de la información la mantiene bombeando más intensamente. O quizás sea porque es más lo que experimentamos todo el día. En cualquier caso, esto explica la apuesta de Meta de más de 10.000 millones de dólares de que la RV (realidad virtual) será el medio de la próxima plataforma dominante.

La teoría de la Internet muerta– que se hizo viral hace un par de años, postulaba que Internet es una tierra de nadie de bots y falsificaciones.

Si buscas la frase I hate texting en Twitter y te desplazas hacia abajo, empezarás a notar un patrón. Una cuenta con el nombre @pixyIuvr y un corazón brillante como imagen de perfil tuitea: «I hate texting I just want to hold ur hand» (odio los mensajes de texto, sólo quiero coger tu mano), recibiendo 16.000 likes. Una cuenta con el nombre @f41rygf y una esfera rosa como imagen de perfil tuitea: «I hate texting just come live with me», recibiendo casi 33.000 likes. Una cuenta con el nombre @itspureluv y una esfera rosa como imagen de perfil tuitea: «iIhate texting I just wanna kiss u», recibiendo más de 48.000 likes.

He aquí algunos estudios del caso (trata las cifras con sano escepticismo, es imposible determinarlas de forma fiable):

- Elon Musk estima que el 20% de los usuarios de Twitter son bots. Los autores de este artículo sugieren un 14% como límite superior.

- Supuestamente, el 10% -o alrededor de 95 millones- de las cuentas de Instagram son cuentas de bots/spam.

- En un estudio sobre la primera destitución de Donald Trump (el mismo artículo enlazado anteriormente), los bots representaban el 1% de los usuarios activos, pero publicaron el 31% de los tuits.

- Un 42% de las reseñas de Amazon son falsas. Amazon demanda a Facebook por «no atajar las fábricas de reseñas falsas.

- TikTok tampoco es inmune. Los bots están inflando artificialmente la popularidad de las cuentas y publicando vídeos que son esencialmente anuncios. Aquí tienes una guía completa para comprar bots en TikTok.

- Según este artículo, «más del 80 por ciento de los NFT acuñados de forma gratuita en OpenSea son falsos, plagiados o spam«.

La cuestión es que, una vez que se crea una cuenta, es trivial publicar computacionalmente nuevos contenidos e interactuar con los participantes de la plataforma. Y eso puede distorsionar artificialmente el debate.

¿Recuerdan el caso de Cambridge Analytica? El asunto demostró que es posible manipular a las personas a escala masiva por el contenido que consumen (en este caso concreto, anuncios políticos).

Pero todo ese contenido fue creado por humanos. Y los humanos son lentos para crear.

Las eras del contenido en la web empiezan a ser algo así

humano, contenido real < humano, contenido falso < IA, contenido falso

- dominan los contenidos reales generados por personas reales

- contenido falso generado por personas reales para engañar (piensa en las reseñas falsas, Cambridge Analytica, etc.).

- Por último, la era del contenido falso creado por la IA.

A medida que los modelos generativos se vuelvan cada vez más sofisticados (GPT-3, DALL-E 2, Imagen, Copilot), ciertos aspectos de la Teoría de la Internet Muerta cobra más vigencia.

Todavía no han llegado a ese punto, pero, como siempre se pregunta Károly Zsolnai-Fehér, de Two Minute Papers, «¿qué aspecto tendrá esta tecnología dentro de dos años?». Teniendo en cuenta lo mucho que han avanzado los modelos generativos de texto, audio e imagen en sólo dos años, esta proposición debería ser alarmante.

En la actualidad, las versiones más atractivas de estos modelos se encuentran en gran medida detrás de los muros de las empresas, con acceso exclusivo mediante listas de espera a investigadores y profesiones específicas.

Pero a medida que los algoritmos mejoren y se reduzcan, se democratizarán cada vez más y estarán al alcance de cualquier persona con acceso a Internet.

¿Qué herramientas están disponibles -ahora mismo- para cualquiera? midjourney tiene un estupendo bot de Discord que permite hacer precisamente eso. Eleuther tiene una demo de GPT-J disponible. Hay montones de cuadernos de Google Colab disponibles (ejemplo) para jugar con todo esto. Stability.ai acaba de poner a disposición su modelo de generación de imágenes de difusión estable en huggingface y en su propio sitio web, creator.nightcafe.studio.

Y adivinen qué, estamos empezando a ver el efecto.

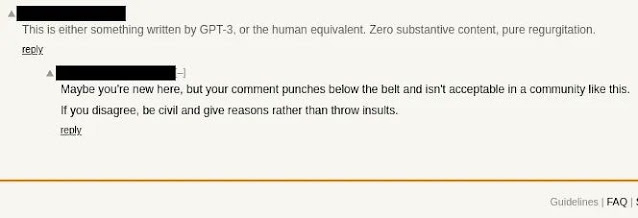

Este post generado por GPT-3 obtuvo 26.000 visitas y 60 suscriptores en un corto periodo de tiempo. Un comentario que sugería que era falso fue rápidamente descalificado y falsamente rebatido.

- 23 de agosto de 2022: se informó de que «un conjunto de hackers consiguió hacerse pasar por el director de comunicaciones (CCO) de Binance, Patrick Hillmann, en una serie de videollamadas con varios representantes de proyectos de criptodivisas.»

- 23 de agosto de 2022: un artículo en la portada de Hacker News sugería que podría haber un conjunto de artistas turbios en Spotify creando canciones generadas por la IA.

- [Hay una industria artesanal de herramientas de «desnudo profundo» (por ejemplo) en las que los usuarios pueden subir fotos de mujeres vestidas y recibir una imagen de vuelta con la ropa quitada. Recientemente se ha presentado un Show HN en el que se muestra un GAN para desnudos falsos.

- Dos investigadores de Stanford han descubierto el uso generalizado de cuentas falsas de LinkedIn creadas mediante IA. «Estos perfiles se dirigen a usuarios reales en un intento de aumentar el interés por determinadas empresas antes de pasar los contactos exitosos a un vendedor real».

Old man yelling at cloud

Pregunta: ¿Podemos innovar para salir de este problema?. Ya vendrán nuevas empresas y tecnologías para combatirlo. Sólo estás cayendo en la trampa en la que cayeron otros innumerables seres humanos cuando aparecieron las nuevas tecnologías. Básicamente, eres como ese movimiento que se manifiesta en contra de la legislación que obliga a la gente a usar el cinturón de seguridad.

Un experimento

¿Hacia dónde vamos a partir de ahora?

Nota de Chitauri:

«Falsos humanos crearán falsas realidades y se las venderán a otros humanos, volviéndolos a su vez falsificaciones de sí mismos». Philip K. Dick

Nota de Chitauri:

–

FUENTE